Elon Musk dan Stephen Hawking Memperingatkan Robot Militer AI Dapat Memicu Perlombaan Senjata Global Berikutnya

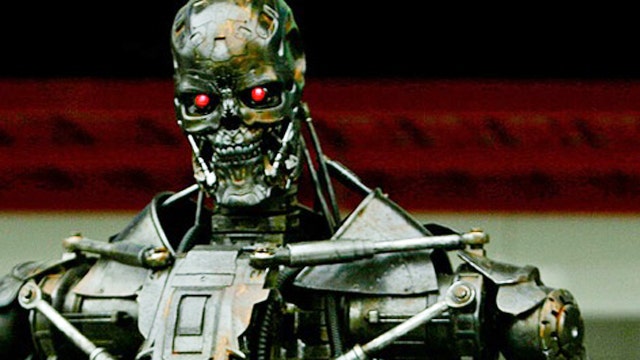

Bayangkan masa depan di mana robot militer dengan kecerdasan buatan (AI) memutuskan siapa yang harus dibunuh, kapan, dan mengapa – sepenuhnya mandiri, tanpa campur tangan manusia. Stephen Hawking, Elon Musk, dan Steve Wozniak pernah mengalaminya — dan bersama-sama mereka menyerukan umat manusia untuk menghentikan kemungkinan mengerikan itu sebelum hal itu terjadi.

Para intelektual terkenal dunia bergabung dengan beberapa orang hari ini 1.000 pemimpin pemikiran dan peneliti AI dan robotika untuk memperingatkan bahwa senjata otonom dapat memicu perlombaan senjata global berikutnya. Artinya, jika kita tidak menghentikan mesin pembunuhnya terlebih dahulu.

Terkait: Mengapa kita tidak perlu takut dengan kecerdasan buatan

Pesan tajam mereka tampak pada a surat Terbuka diterbitkan online hari ini oleh yang berbasis di Boston Institut Kehidupan Masa Depan (FLI). Pesan tersebut – juga ditandatangani oleh CEO Google DeepMind Demis Hassabis, direktur riset Google Peter Norvig dan ilmuwan kognitif Noam Chomsky – menyerukan pelarangan “senjata otonom yang bersifat ofensif.” Hal ini akan dipresentasikan secara resmi besok pada pembukaan Konferensi Gabungan Internasional tentang Kecerdasan Buatan di Buenos Aires, Argentina.

Surat tersebut memperingatkan: “Jika ada kekuatan militer besar yang melanjutkan pengembangan senjata AI, perlombaan senjata global hampir tidak bisa dihindari, dan titik akhir dari lintasan teknologi ini jelas: senjata otonom akan menjadi Kalashnikov masa depan.”

Seberapa cepatkah “besok” ini, menurut para pemikir terkemuka di balik ajakan bertindak yang tegas, jika tidak mengkhawatirkan? Kita berbicara bertahun-tahun. “Teknologi Kecerdasan Buatan (AI) telah mencapai titik di mana penerapan sistem seperti itu dalam beberapa tahun, bukan beberapa dekade, secara praktis atau bahkan tidak layak secara hukum,” kata surat itu.

Terkait: Manusia + AI = Masa Depan Bisnis Anda

Penulisnya mengutip penggunaan quadcopter pembunuh bersenjata, “yang dapat mencari orang-orang yang memenuhi kriteria tertentu yang telah ditentukan,” sebagai contoh jenis teknologi yang dapat “memilih dan menyerang target tanpa campur tangan manusia.” (Anda mungkin ingat, minggu lalu, seorang konsumen drone yang digerakkan dengan pistol membakar internet, meskipun tampaknya dikendalikan oleh orang yang rendah hati.)

Surat empat paragraf bukanlah malapetaka dan kesuraman. Perjanjian ini secara singkat mengakui bahwa mesin perang AI dapat memberikan manfaat bagi manusia dengan menggantikannya dalam pertempuran, sehingga berpotensi mengurangi korban jiwa. Namun di sisi lain, hal ini bisa menjadi bencana, berpotensi “menurunkan ambang batas untuk berperang”, memicu terorisme dan mengganggu stabilitas negara.

Terkait: 5 Hal yang Tidak Anda Ketahui Tentang Elon Musk

Ini bukanlah kali pertama Hawking Dan Musk telah secara terbuka menyerukan kehati-hatian terkait penerapan AI. Januari lalu, keduanya menandatangani dokumen FIL serupa. Laporan ini juga menyatakan perlunya mencegah potensi distopia yang disebabkan oleh AI, sekaligus mendesak eksplorasi penggunaannya untuk “pemberantasan penyakit dan kemiskinan.”

Wozniak juga menandatangani surat yang sama sebelumnya, meskipun pandangannya terhadap AI tampaknya melunak sejak saat itu. Salah satu pendiri Apple baru-baru ini mengatakan bahwa dia sudah mengatasi ketakutannya bahwa kita akan digantikan oleh bot dengan kecerdasan buatan. Ketika mereka akhirnya mengambil alih, dia pikir kita akan mengambil alih hewan peliharaan yang baik untuk mereka.

Terkait: Uang Elon Musk digunakan untuk menghentikan AI memusnahkan manusia